来看下我装备了5060TI显卡的gpt-oss模型表现

之前在我的3060笔记本上试了有显卡的情况下gpt-oss的表现,只能说勉强可以用,比mbp上是可用了很多,毕竟那玩意除非完全把内存都让给gpt-oss,不然都跑不起来,只是生成速度还是有点感人,差不多就4.66token/s,一直觉得能在本地跑个稍微能用点的模型还是种比较不错的体验,所以在最近买了个5060TI,因为这个是最便宜的16G显存的家用显卡了,当然排除各种魔改卡,比如镭7这种,当然喜欢折腾的也可以买来玩玩,硬件上要玩起来还是需要比较多时间的

今天用同样的prompt来再对比测试下

3060 6g笔记本显卡

prompt是帮我用react写一个todo应用,样式要美观精致

我们先对比下效果

生成的还是比较简介,重要的是正确的1

2

3

4

5

6

7

8

9

10

11

12

131.77 token/s

•

2926 token

•

首个token用时 2.21 s

•

停止原因: 检测到 EOS token

对比的是

5060ti 16g显卡

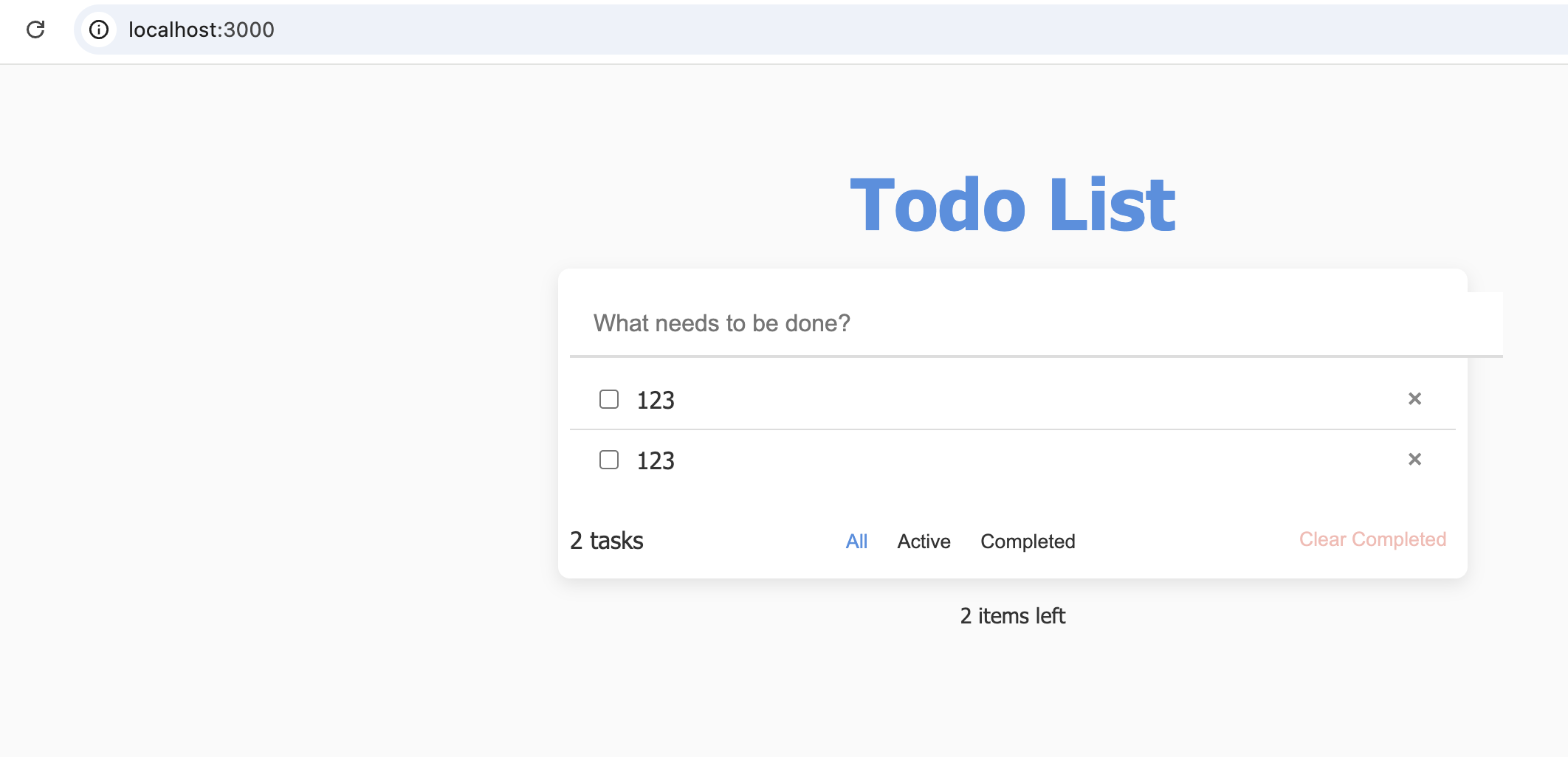

我们也来看下效果

样式稍稍有点问题,但是能一次运行成功1

2

3

4

5

6

7

8

9

10

11

12

1327.91 tok/sec

•

2236 tokens

•

0.41s to first token

•

Stop reason: EOS Token Found

对比两次运行,其实3060在一开始think的时候也耗时比较久,后续生成的速度差异也是比较大的

这简单对比比较能看出来能把整个模型权重加载进显存还是有比较大优势的,不过既然本身可以不全加载进显存,我是不是也可以试试32B的模型,毕竟有16+32的显存组合,16显存+32是内存共享的,下次可以体验试试看,比如32B的qwen模型