结合本地部署的蒸馏 deepseek 大模型和 Anything LLM 来实现rag功能

之前我们用LM Studio 本地部署了 deepseek的蒸馏大模型,虽然肯定无法跟满血版比,但是对于本地的一些小应用还是可以尝试的

这边我们就不自己实现了,借助于 Anything LLM来做个尝试

首先可以在 anythingllm 下载对应系统版本的 Anything,注意安装的时候它有两个阶段,会走两次进度条,第二次会慢一些。

安装好后,我们要选择它的大模型供应者

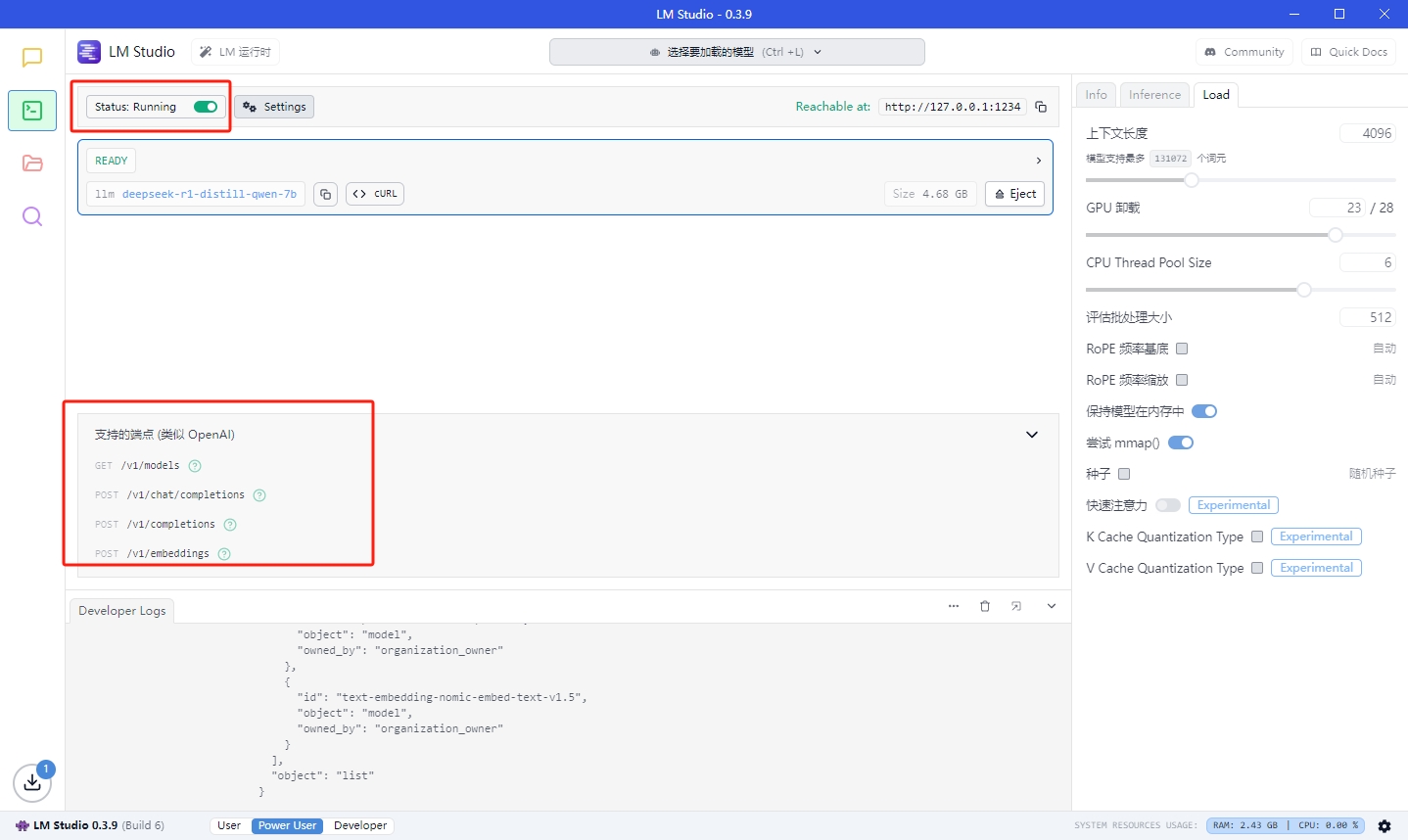

先要在LM Studio中开启http服务,

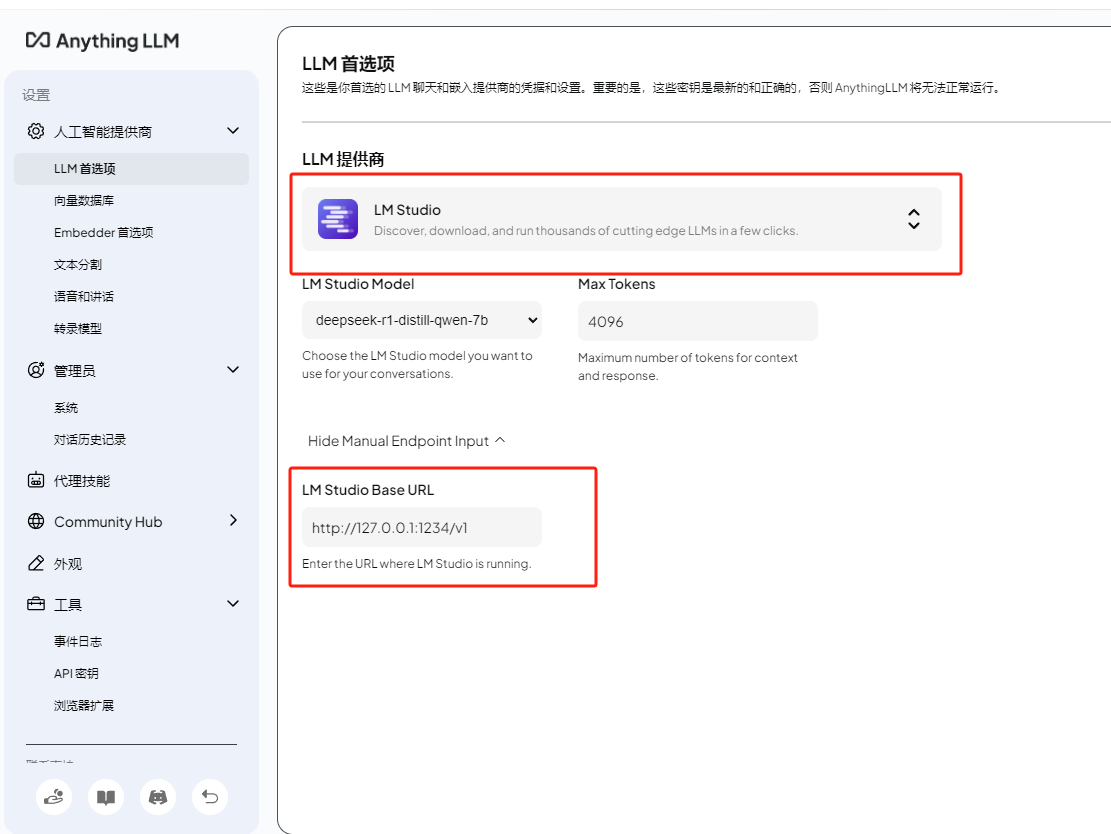

然后再在 AnythingLLM 中选好以 LM Studio 作为大模型提供商

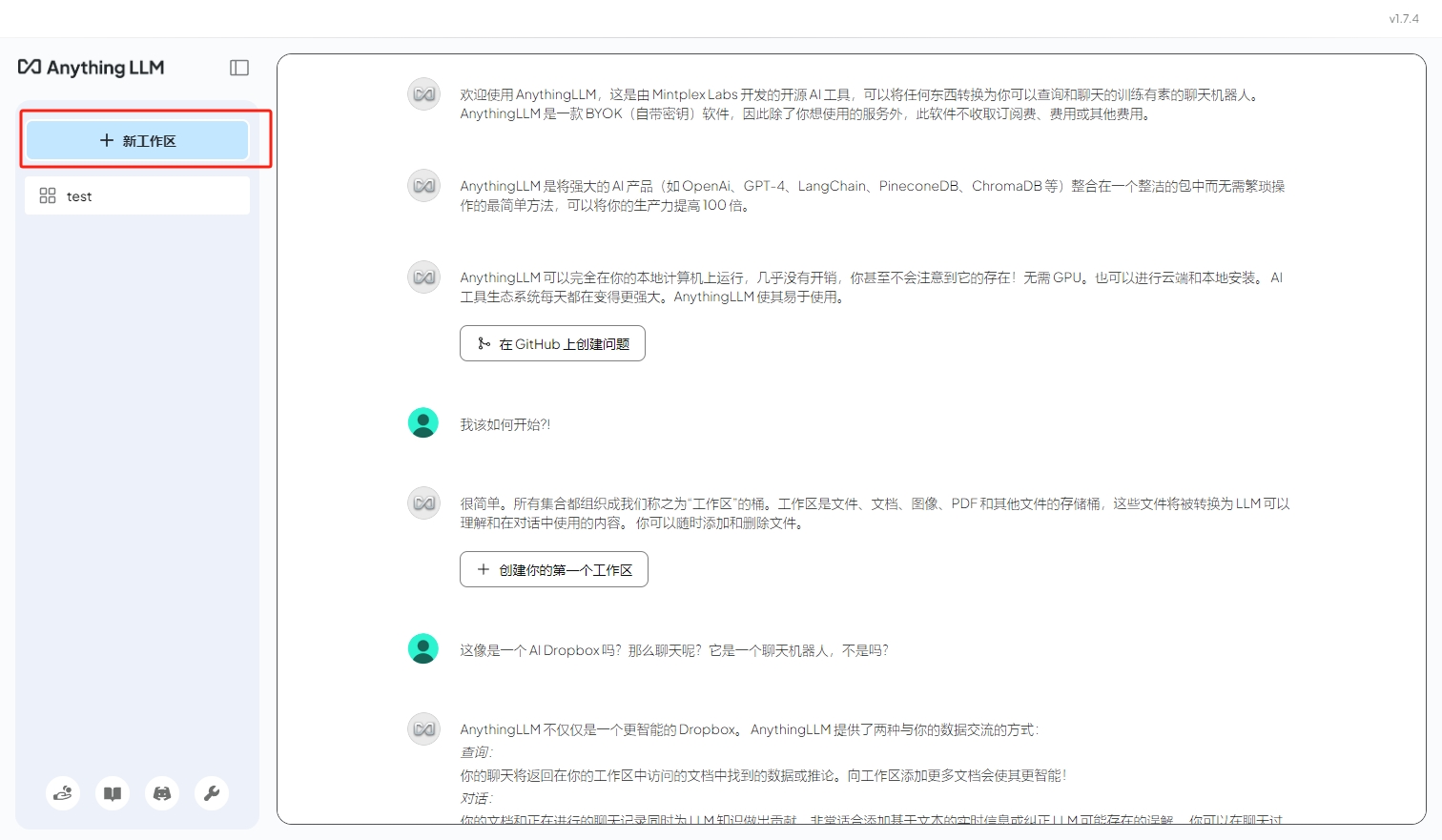

之后在 Anything 窗口中可以新建一个工作区

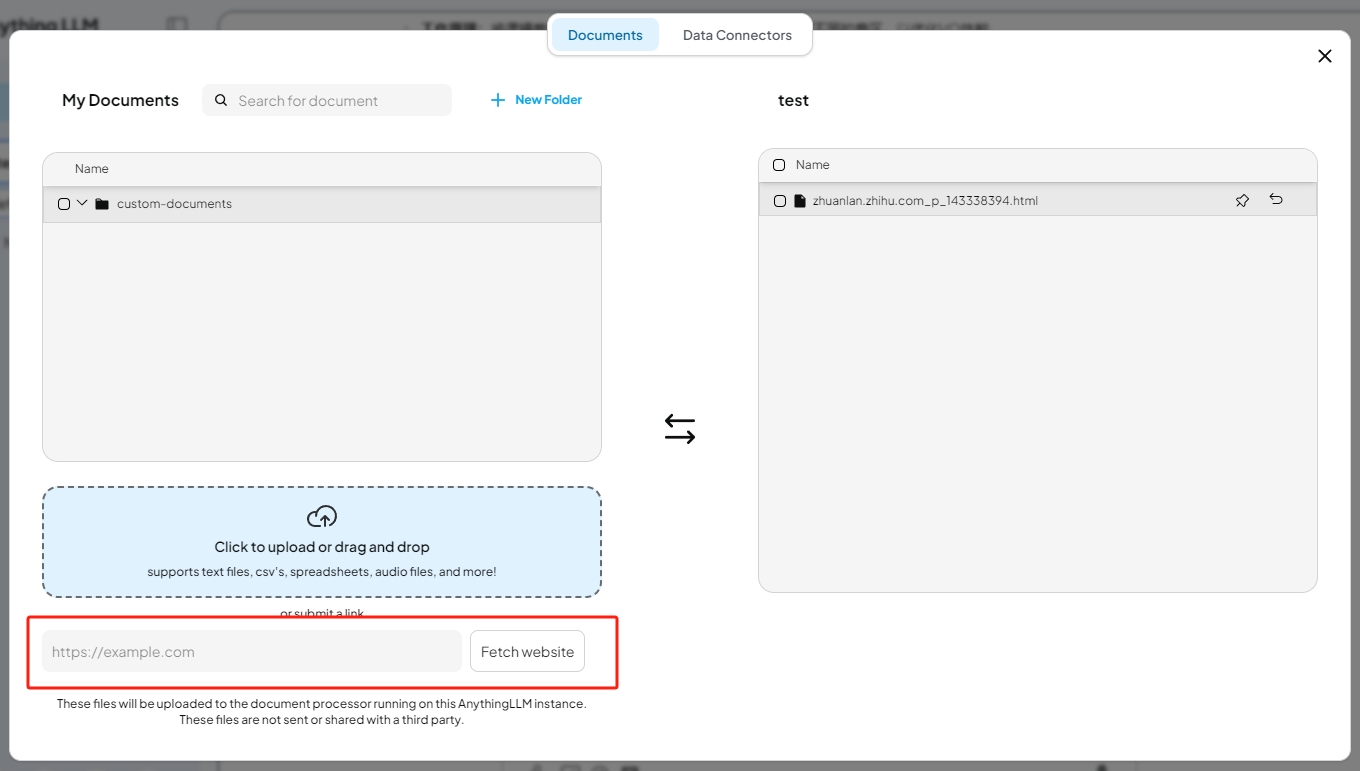

新建完之后,我们为了实现rag功能,就用个简单的示例,比如以raid 作为话题,我找到某乎的一篇文章

点击左侧工作区旁边的上传

我们可以这里提交链接,由Anything LLM帮我们把网页保存下来然后embedding到向量数据库里,然后就可以在我们对话的时候根据这个文章来做增项

然后我们问个问题,就可以发现它已经借助于本地文档的信息来增强内容生成

这样就非常方便的实现了rag,还可以提交本地的笔记文稿等,现在这些应用也已经变得越来越成熟了。